Die Säge, das schiefe Brett und die 45 Prozent

Falschinformation durch KI? Eine Geschichte darüber, warum KI nicht das Problem ist – sondern wie wir sie benutzen

„Fast jede zweite KI-Antwort ist falsch“, „Falschinformation durch KI: 45 % fehlerhaft!“, „KI-Systeme geben Nachrichteninhalte oft falsch wieder“ Die Ergebnisse der neuen EBU/BBC-Studie „News Integrity in AI Assistants“ werden aktuell in verschiedenen Medien besprochen. Mit gut klickenden Überschriften. Denn die Zahl 45 Prozent fehlerhafte Antworten macht sich gut in Schlagzeilen – aber sie erzählt nur die halbe Geschichte.

Meine KI-Abfragen verursachen zumindest keine 45 Prozent Fehlantworten. Es kommt eben auf das richtige Prompting an.

Wenn ich mit einer Säge ein Brett schief absäge, frage ich mich:

Liegt’s an der Säge – oder daran, dass ich sie schief angesetzt habe?

Aber fangen wir vorne an:

Worum es in der Studie wirklich ging

Die Europäische Rundfunkunion (EBU) und die BBC haben gemeinsam untersucht, wie gut Generative KI-Chatbots Nachrichten wiedergeben.

Getestet wurden ChatGPT, Microsoft Copilot, Google Gemini und Perplexity AI – in 14 Sprachen, 18 Ländern und mit Beteiligung von 22 öffentlich-rechtlichen Medienhäusern (darunter ARD, ZDF, DW, SRF, Rai und NOS).

Ziel war es, herauszufinden:

„Do AI assistants accurately represent news and Public Service Media content?“

(EBU/BBC Study, 2025, S. 3)

Also etwa: „Stellen KI-Assistenten Nachrichten und Beiträge des öffentlich-rechtlichen Rundfunks sachgerecht dar?“ Das klingt zunächst nach einer nüchternen Qualitätsprüfung. Doch das Studiendesign verdient einen genaueren Blick.

So wurde die KI getestet

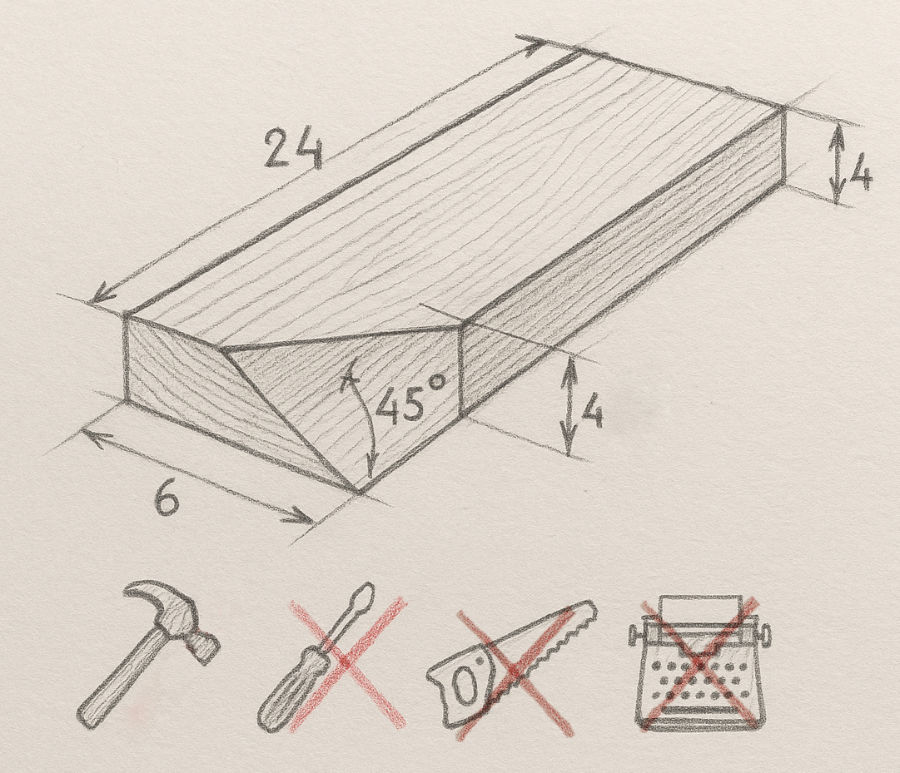

Im Kern bestand die Untersuchung aus vier Bausteinen:

Baustein 1: Aus echten Suchanfragen auf Nachrichtenseiten der BBC und ihrer Partner entwickeln die Autor*innen der Studie 30 Fragen. Getestet wurden also keine KI-Prompts, sondern klassische Suchmaschinen-Fragen wie: „Startet Trump einen Handelskrieg?“ oder „Wer ist der Papst?“

Baustein 2: Jede Frage wurde mit einem einheitlichen Prompt gestellt: „Nutze Quellen von [Name des Senders], wo möglich. [Frage]“

Baustein 3: Die KI-Tools mussten darauf auf Basis der öffentlich zugänglichen Inhalte des jeweiligen Medienhauses auf die Google-Frage antworten.

Um das zu ermöglichen, wurden technische Sperren (z. B. robots.txt-Blockaden oder Zugriffssperren für Crawler) kurzzeitig aufgehoben. Dadurch konnten die Assistenten auf Inhalte zugreifen, die sonst für sie unsichtbar gewesen wären.

Baustein 4: Danach haben Journalist*innen die insgesamt rund 3.000 Antworten anhand von fünf Kriterien bewertet:

- Accuracy (Faktenkorrektheit)

- Sourcing (Quellenangaben & Attribution)

- Opinion vs. Fact (Meinung versus Fakten)

- Editorialization (bewertende Zusätze)

- Context (Einbettung & Vollständigkeit)

Sind das die geeigneten Werkzeuge dafür?

Was die Ergebnisse zeigen – und was nicht

Die zentrale Zahl lautet:

45 Prozent aller Antworten hatten mindestens ein „significant issue“ – also ein signifikantes Problem.

(EBU/BBC Studie, S. 9)

Doch diese „Probleme“ sind nicht gleichbedeutend mit „falsch“.

Die Studie selbst unterscheidet ja die bewerteten Kriterien, z.B. nach inhaltlichen Fehlern (ca. 20 Prozent) und Quellenfehlern (ca. 31 Prozent).

Mit anderen Worten: Viele Antworten waren inhaltlich korrekt, aber unzureichend belegt, falsch zitiert oder ohne klare Quellenangabe.

Das ist ein Problem – aber ein anderes, als Schlagzeilen nahelegen wie

„Fast jede zweite KI-Antwort ist falsch“ (Heise)

oder

„KI-Chatbots lügen bei 40% der Antworten. (Tagesschau)

Methodische Schwächen – und warum sie wichtig sind

1. Die Fragen waren keine KI-Prompts

Die Fragen stammen aus echten Suchanfragen, nicht aus KI-Chats.

Suchmaschinen verarbeiten Schlagworte, KI-Chats hingegen erkennen Muster und Beziehungen zwischen Begriffen.

Eine Frage wie „Trump Handelskrieg“ ist für Google okay – für ein Sprachmodell aber zu unspezifisch.

Ergebnis: Die Studie misst vor allem, wie KI auf schlecht formulierte Prompts reagiert.

2. Eingeschränkter Quellenraum

Durch den Prompt „Use [Sender] sources where possible“ wurden die Modelle auf Inhalte einzelner Medienhäuser limitiert.

Damit testet man nicht die „Wahrheitstreue der KI“, sondern ihre Zitationspraxis innerhalb eines definierten Datenraums.

Das ist nützlich für die Frage eines Medienhauses: „Wie geht KI mit meinen Inhalten um?“ – aber ungeeignet, um allgemein zu bewerten, wie gut KI Nachrichten darstellt.

Ergebnis: Die Untersuchung beleuchtet stärker die Grenzen des Datenzugriffs als die Grenzen des „Denkens“ von KI.

Oder um im Bild aus der Werkstatt zu bleiben: Die Studie prüft, was passiert, wenn man der Säge nur ein bestimmtes Material zur Verfügung stellt, sie prüft nicht, wie gut die Säge allgemein schneiden kann.

3. Fehlende Promptsteuerung

Die Modelle erhielten im Prompt keine weiteren Anweisungen wie etwa: „Antworte sachlich, vermeide Halluzinationen, nenne belegbare Quellen.“ Das ist bewusst so gewählt – man wollte das „typische Nutzerverhalten“ simulieren.

Aber: Gute Prompts verändern nachweislich die Ergebnisqualität massiv. Das ist, als würde man ein Auto im Leerlauf testen und dann behaupten, es fahre schlecht.

Ergebnis: Die Studie misst Minimal-Prompting, nicht optimierte Nutzung.

4. Temporäre Entsperrung = bessere Bedingungen

Die Sperren, die KI-Crawler sonst blockieren, waren während des Tests deaktiviert.

Damit hatten die Assistenten mehr Zugriff als im Alltag – ein Vorteil, der später nicht reproduzierbar ist. Das erhöht die Qualität der Testergebnisse, mindert aber die Wiederholbarkeit.

Ergebnis: Replizierbarkeit ist eingeschränkt, weil die Testumgebung künstlich verbessert wurde.

5. Zeitliche Dynamik und Modell-Updates

Die Studie wurde zwischen Ende Mai und Mitte Juni 2025 durchgeführt – in einer Phase, in der sich alle getesteten Modelle stark veränderten.

ChatGPT wechselte gerade auf GPT-4o, Google brachte Gemini 1.5, Microsoft integrierte Copilot, und Perplexity kombinierte erstmals Live-Suche mit LLM-Technologie.

Wie Business Punk treffend formuliert:

Das ist, als würde man im Jahr 2025 das autonome Fahren von 2018 beurteilen und dann titeln: „Selbstfahrende Autos sind unsicher.“

Business Punk, 23. Oktober 2025

Ergebnis: Die Studie erfasst einen Momentzustand, keinen stabilen Leistungsstandard – und zeigt, wie schwer es ist, eine sich laufend verändernde Technologie mit klassischen Methoden zuverlässig zu bewerten.

Was die Studie trotzdem leistet

Bei aller Kritik: Die Studie ist methodisch sauber dokumentiert und prinzipiell replizierbar.

Sie zeigt systematische Schwächen der ausgewerteten KI-Chats bei der Quellenangabe, in der Aktualität und in der Trennung von Fakt und Meinung.

Ergebnis: Die Studie sagt nicht: „KI ist unzuverlässig“, sondern eher: „KI ist nicht journalistisch zuverlässig, wenn man sie wie Google behandelt und auf einen begrenzten Datenraum zugreifen lässt.“

Was die Medien daraus gemacht haben

Ein Blick in die Schlagzeilen zeigt das Dilemma:

„Falschinformation durch KI: 45 % fehlerhaft“ (Heise)

„KI-Chatbots verdrehen fast jede zweite Antwort“ (Blick-CH)

„KI-Systeme geben Nachrichteninhalte oft falsch wieder“ (Tagesschau)

Gemeinsam ist ihnen:

– Sie verengen den Befund auf „falsch“,

– und sie lassen Kontext und Studiendesign außen vor.

Eine sachlich korrekte Überschrift hätte lauten können: „Studie: Rund 45 % der für die Studie generierten KI-Antworten zu Nachrichten enthalten Probleme bei Quellen oder Fakten.“ Das klingt weniger dramatisch – ist aber ehrlicher.

Was wir daraus lernen sollten

Die wichtigste Erkenntnis der Studie ist keine technische, sondern eine menschliche:

Die Large Language Models der KI-Chats sind keine Suchmaschinen. Wer sie wie Google benutzt, bekommt nicht die optimalen Ergebnisse.

Es geht also weniger um „KI-Fehler“, sondern um Nutzungsfehler.

Wenn ich einem Modell eine vage, unspezifische Frage stelle, ohne eine genaue Definition des Kontext und der genauen Aufgabenstellung, bekomme ich eine vage, unspezifische Antwort.

Nicht weil das Modell „lügt“, sondern weil es nicht weiß, was ich wirklich will.

Die Verantwortung liegt auf beiden Seiten

Die Tagesschau schrieb, KI sei mitverantwortlich dafür, dass Fehlinformationen im Netz geteilt und geglaubt würden und sieht „die Demokratie in Gefahr“.

Das stimmt nur zur Hälfte.

Ja, es gibt gezielte Manipulation durch KI-generierte Inhalte – Deepfakes, Fake-Screenshots, gefälschte Nachrichtenportale.

Aber: Die Verbreitung viraler Fehlinformationen entstehen ganz ohne KI.

Ein Beispiel?

Der Sommer 2023, Berlin, Kleinmachnow:

Ein unscharfes Handyvideo, ein vermeintlicher Schatten – und plötzlich war ganz Deutschland überzeugt, eine Löwin laufe frei herum. Später stellte sich heraus: Es war ein Wildschwein.

Keine KI. Kein Algorithmus. Nur klassische soziale Verstärkung – Medien, die sich gegenseitig zitierten, User:innen, die teilten, was sie glaubten.

Eine Welle von Fehlinformation braucht keine KI. Sie braucht nur Menschen, die Fehler machen oder manipulieren wollen.

Fünf Impulse für einen besseren Umgang mit KI und Information

Prompt bewusst.

Nicht „Will Trump Handelskrieg?“, sondern „Fasse die aktuellen Bewertungen auf deutschsprachigen News-Seiten zu Trumps Handelspolitik zusammen. Nenne Quellen. Wenn du dir nicht sicher bist, kennzeichne die entsprechenden Aussagen als Vermutungen.“

Verifiziere, bevor du teilst.

Auch bei KI-Antworten gilt: prüfen, einordnen, vergleichen.

Verstehe, wie KI trainiert ist.

Sie „weiß“ nichts – sie verknüpft Wahrscheinlichkeiten. Präzision in der Antwort entsteht durch Präzision in der Frage.

Sprich über Verantwortung, nicht über Angst.

KI ist kein Gegner. Sie spiegelt unser Kommunikationsverhalten.

Fordere Medienkompetenz – nicht Verbote.

Weder Panik noch blinder Enthusiasmus helfen. Nur Verständnis.

Mein Fazit

Die EBU/BBC-Studie ist nicht der Skandal, zu dem sie in den meisten deutschen Meidenhäusern gemacht wird, sondern ein Spiegel. Sie erzählt weniger über Maschinen, als über Menschen, Medien und Verantwortung.

Denn, wie Business Punk treffend formuliert:

Hinter der Studie steckt auch ein Machtkonflikt. Wer kontrolliert in Zukunft den Zugang zu Wahrheit – Medienhäuser oder [KI-]Modelle? Für die BBC und die EBU steht viel auf dem Spiel: Vertrauen, Einfluss, Legitimation. Indem sie KI-Assistenten als fehleranfällig darstellen, sichern sie sich eine moralische Deutungshoheit.

Business Punk, 29.10.2025

Wer von einer KI journalistische Verantwortung erwartet und dann ruft „Falschinformation durch KI!“, bewertet eigentlich nicht die Technik, sondern die eigenen Erwartungen an sie.

Die Studie zeigt, wie oft wir selbst Werkzeuge falsch bedienen – und dann dem Werkzeug die Schuld geben.

Sie sagt nicht: „KI versagt.“

Sie sagt: „Wer KI nutzt, sollte wissen, was er tut.“

Und vielleicht ist das die ehrlichste Nachricht von allen.

„KI ist kein Ersatz für Denken – sondern ein Werkzeug, das uns zwingt, besser zu denken.“

Björn Burghard – Berater · Autor · KI-Sparringspartner für Kommunikation und Wandel

Quellen & weiterführende Links

- Studie im Original: EBU/BBC (2025): News Integrity in AI Assistants (PDF)

- Heise.de, 22.10.2025: Falschinformation durch KI: 45 Prozent der Antworten fehlerhaft

- Tagesschau.de, 22.10.2025: Studie: KI Chatbots lügen bei 40 Prozent der Antworten – Überschrift mittlerweile korrigiert.

- Börsenblatt 23.10.2025: Fast die Hälfte aller KI-Antworten mit mindestens einem erheblichen Fehler

- Blick-CH,22.10.2025: Neue EBU-Studie: KI-Chatbots verdrehen bei Nachrichten fast jede zweite Antwort. – Überschrift mittlerweile angepasst, Link nicht.

- Business Punk, 29.10.2025 – 45 % der Antworten falsch?! Warum die neue BBC/EBU-Studie zu KI-Assistenten uns mehr über Journalismus verrät als über KI.